起止时间:03/2026 ~ 04/2026

技术栈:[ROS2, Rviz, yoloV8, Piper, Orbbec, CAN, VLA, ACT, Diffusion Policy]

基于 OpenClaw Skill 框架,构建了一个由 Agent 驱动的视觉引导机械臂抓取系统,实现了从感知、决策到执行的端到端闭环控制。

🧩 系统完整能力拆解

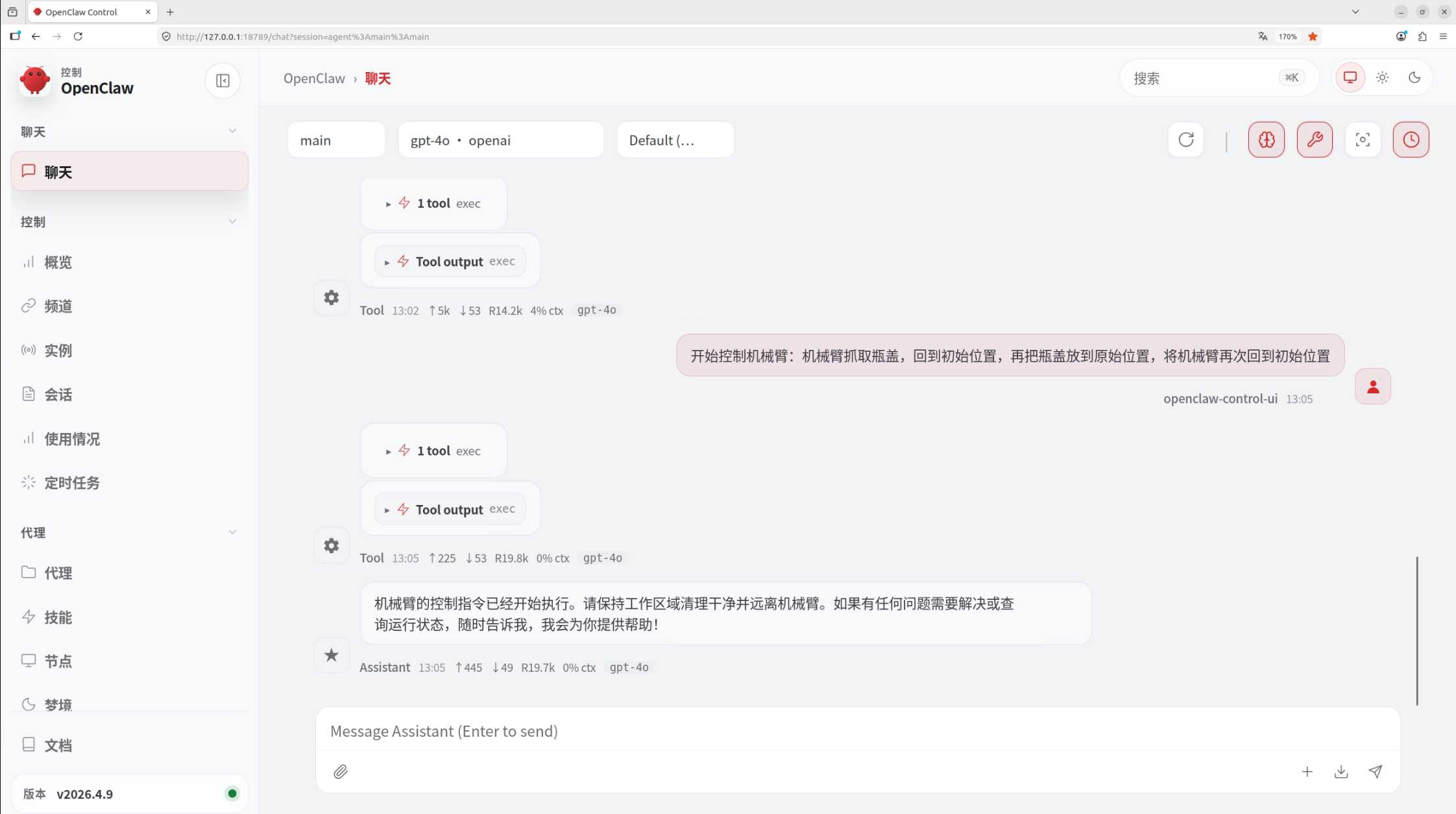

1. Agent 控制层(小龙虾)

- 基于 Agent(你说的“小龙虾”)作为决策中枢

- 负责任务理解 + 调用 Skill

- 实现:

“看见 → 理解 → 决策 → 执行”

👉 本质:

AI 在调度机器人能力(具身智能雏形)

2. Skill 执行层(OpenClaw 框架)

- 使用 OpenClaw 定义 Skill

- 将机器人能力模块化:

视觉 Skill

抓取 Skill

运动 Skill - 特点:

可组合

可扩展

支持 Agent 调用

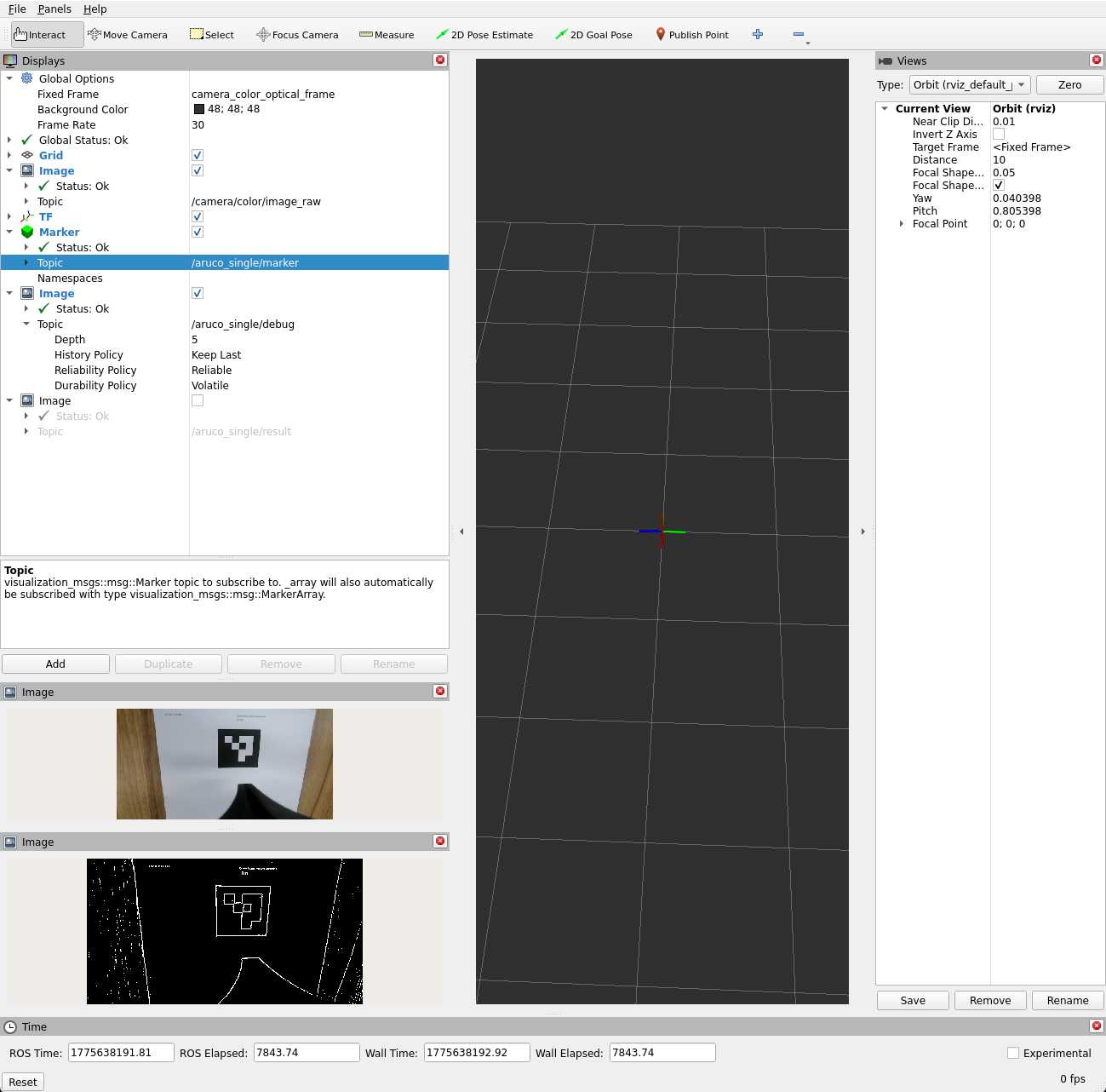

3. 视觉感知(Perception)

- YOLO 目标检测

- 实时识别目标(cup / bottle 等)

- 输出类别: bounding box

4. 空间定位(3D理解)

- 深度相机获取距离信息

- 计算:像素坐标 → 相机坐标系

5. 手眼标定(关键能力)

- 完成:

相机坐标系 → 机械臂坐标系 - 作用:

解决“看见 ≠ 抓得到”的核心问题

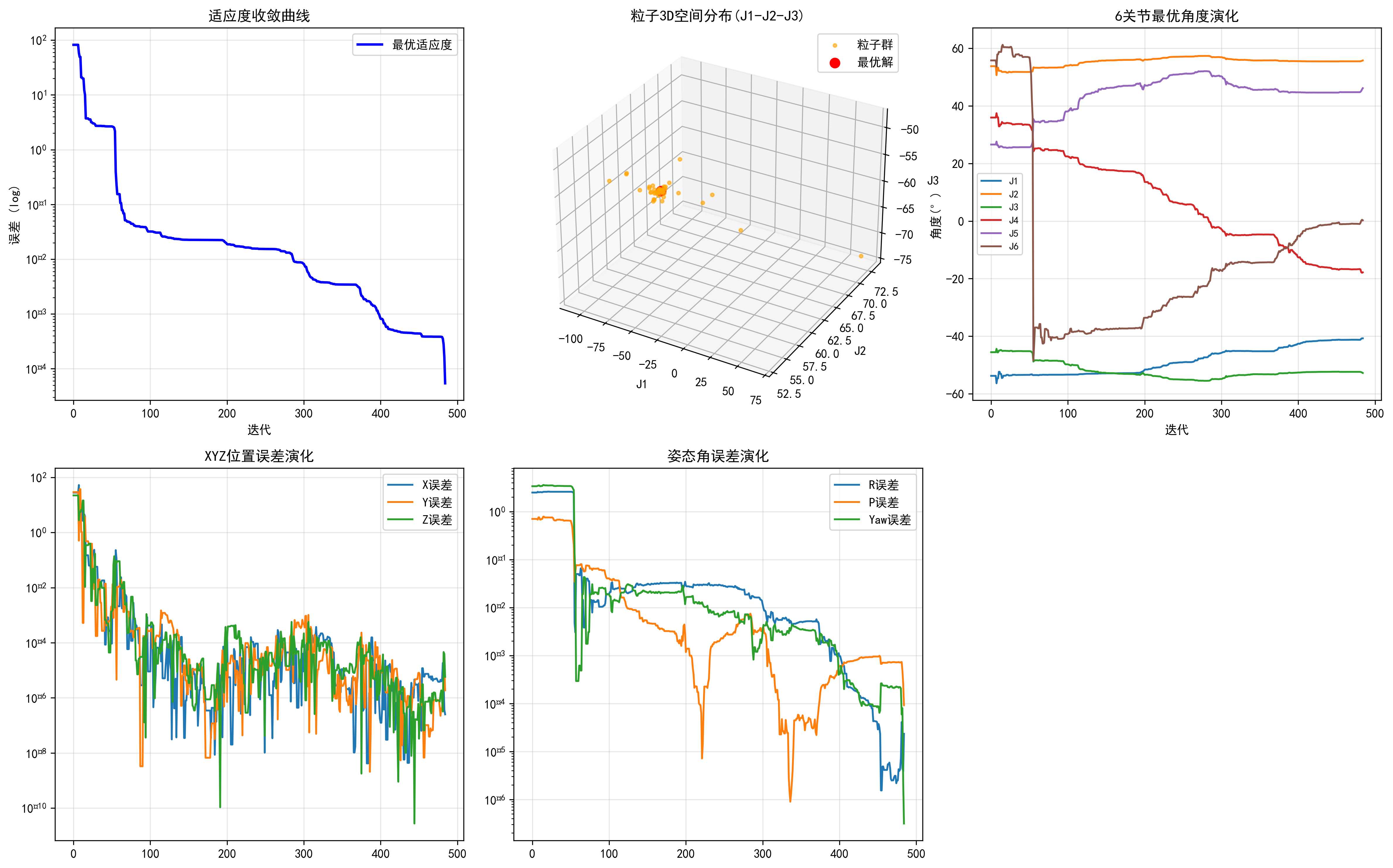

6. 抓取优化(PSO)

- 使用 PSO(粒子群优化)

- 对抓取点 / 抓取姿态进行优化

- 提升:

抓取成功率

稳定性

7. 机械臂控制(执行层)

- 基于 SDK 控制机械臂运动

- 完成:

轨迹执行

抓取动作

8. 系统闭环

用户/任务

↓

Agent(小龙虾)

↓

Skill调用(OpenClaw)

↓

视觉感知(YOLO + 深度)

↓

坐标计算 + 手眼标定

↓

PSO优化抓取点

↓

机械臂执行抓取

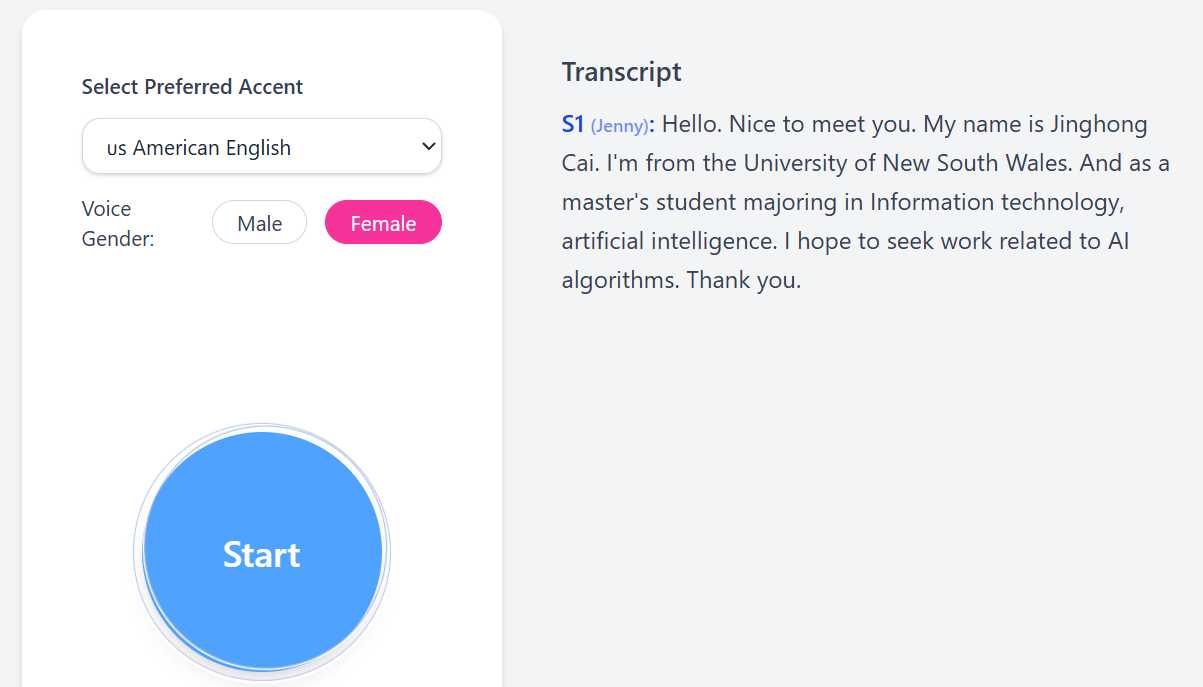

bilibili效果展示

OpenClaw

OpenClaw handeye calibration ros,手眼标定法

handeye calibration ros,手眼标定法 Particle Swarm Optimization,粒子群优化算法

Particle Swarm Optimization,粒子群优化算法

- 本文链接: https://jinhongcai.work/2026/04/15/robotics/openclaw_piper/

- 版权声明: 本博客所有文章除特别声明外,均默认采用 CC BY-NC-SA 4.0 许可协议。